Il robot, una mente artificiale in un corpo artificiale

- 17493 reads

Il robot, unione di mente sintetica e di corpo sintetico, rappresenta l’ultima versione del nostro tentativo plurisecolare di costruire l’uomo artificiale. La somiglianza sempre più spinta tra robot e uomo, che si estende alle capacità cognitive, all’autonomia e in prospettiva anche alle emozioni e forse alla coscienza, pone interrogativi inquietanti. La crescente diffusione dei robot in tutti i settori della società ci obbliga a considerare il rapporto di convivenza uomo-macchina in termini inediti, che, forse sorprendentemente, coinvolgono anche l’etica. Affrontare questi problemi è importante e urgente.

Mentre l'evoluzione biologica ha dotato gli organismi viventi prima di un corpo e poi di un cervello, avente funzioni di controllo centrale e dotato in certi casi di proprietà cognitive superiori, non strettamente necessarie alla regolazione del corpo, l'intelligenza artificiale funzionalistica ha invece cercato di costruire una mente senza corpo, cioè un'intelligenza che imitasse le funzioni simboliche e astratte del cervello biologico evitando ogni interazione con un ambiente considerato fonte di disturbo. Tuttavia le difficoltà di estendere questa forma d'intelligenza artificiale al di fuori dei domini simbolico-formali hanno fatto ritenere che soltanto accoppiando la mente artificiale all'ambiente, attraverso un corpo artificiale dotato di sensi e di organi attuatori, si potesse ottenere un'intelligenza flessibile e ad ampio spettro com’è quella biologica.

Il recupero della dimensione corporea e sensoriale ha portato ai robot e ha aperto una serie di interrogativi che vanno dagli aspetti tecnici della loro costruzione fino a sottili questioni di natura etica. Infatti il robot è un artefatto capace di apprendere e dotato di una certa autonomia di decisione e comportamento. Queste caratteristiche, in una prospettiva di stretta convivenza uomo-robot, non possono non sollevare certe domande:

- Fino a che punto siamo disposti a convivere coi robot, ad affidarci a loro nella vita quotidiana, nell’accudimento e nelle cure?

- Se i robot dovessero un giorno diventare intelligenti e sensibili (quasi) quanto gli umani, potremmo continuare a considerarli macchine, come le lavatrici o le automobili? O dovremmo adottare atteggiamenti empatici e comprensivi come nei confronti degli animali domestici? Dovremmo arrivare ad attribuire loro dignità etica?

- E viceversa: quali comportamenti dei robot dovremmo tollerare, incoraggiare o vietare? E di chi sarebbero le responsabilità di un loro eventuale comportamento dannoso?

L’ultima domanda è importante perché rivela il conflitto tra la natura artificiale dei robot, per cui essi dovrebbero obbedire alla nostra programmazione, e la loro parziale autonomia (se un robot non è autonomo non è un robot) che, in linea di principio, potrebbe indurli a decisioni nocive nei nostri confronti. Erano problemi di questo genere che aveva in mente Asimov quando nei primi anni 40 postulò le “Leggi della robotica”, che vietano ai robot di compiere azioni dannose per gli esseri umani e che costituiscono il primo embrione di un’etica dei robot o, con un espressivo neologismo, di una “roboetica”.

In questo ambito le previsioni si mescolano facilmente con la fantascienza e accanto alle speculazioni ci sono le realtà: in Giappone (il paese di gran lunga più avanzato nella costruzione e nell’impiego dei robot) si tocca con mano quanto possa diventare intenso il rapporto uomo-macchina quando il robot sia un (o una) “badante” con sembianze umane oppure quando abbia più o meno le fattezze e il comportamento di un animale domestico (si pensi ad Aibo, il robot cane della Sony, ormai fuori produzione, che per anni ha svolto la funzione di “animale” da compagnia).

La proiezione affettiva è tanto forte da suscitare problemi psicologici e, ancora una volta, etici. E poi, in generale, la marcia sempre più convulsa di una tecnologia invasiva e onnipresente non può non avere effetti profondi sull’immagine che abbiamo di noi stessi e sul nostro stesso essere “umani”: specchiandoci in quello straniante alter ego che sta diventando il robot, quale immagine ce ne ritorna? Riusciremo, per differenza o per similarità, a capire qualcosa di più di noi stessi? Che questi problemi siano importanti e urgenti, è confermato dall’istituzione di un Comitato tecnico per la roboetica in seno alla Robotics and Automation Society dell’IEEE (Institute of Electrical and Electronics Engineers).

Dopo un breve inquadramento storico dedicato al passaggio dall’intelligenza artificiale funzionalistica alla robotica, sottolineeremo l’importanza del corpo sotto il profilo cognitivo e attivo e considereremo i problemi etici sollevati dalla presenza sempre più diffusa dei robot. Tali problemi sono acuiti dalla somiglianza crescente che presentano con gli umani, oggi sul piano cognitivo e attivo e, domani, forse, anche sul piano emotivo e della coscienza. (1-continua)

Golem, Frankenstein & Co.

- 17998 reads

«Ti chiesi io, Creatore, dall’argilla di foggiarmi uomo,

ti chiesi io di suscitarmi dall’oscurità?»

(John Milton, Paradiso Perduto)

L'impresa della robotica si colloca nel solco del millenario tentativo di imitare l'atto divino della creazione. Più o meno dichiarata, quest'ambizione risale all'antichità biblica e classica, e la leggenda del Golem ne è forse l'esempio mitologico e letterario più noto. Golem è parola ebraica che significa “massa informe”: essa compare nell’Antico Testamento (Salmo 139) e indica Adamo prima che gli sia infusa l’anima.

Secondo la leggenda, grazie alle arti magiche, era possibile fabbricare un Golem di argilla, dargli movimento, e impiegarlo per eseguire compiti faticosi. In particolare lo si poteva usare come forte e ubbidiente difensore del popolo ebraico contro le persecuzioni.

Forza e ubbidienza erano appunto le caratteristiche del Golem, il quale tuttavia, privo di anima com’era, non era in grado di pensare o di provare emozioni. E’ interessante osservare come il pensiero e le emozioni siano anche oggi al centro degli interessi della robotica: la costruzione di robot intelligenti e di robot emotivi rappresenta uno dei traguardi più ambiziosi del settore: ma se alcuni progressi sono stati fatti per quanto riguarda l’intelligenza, il traguardo delle emozioni è ancora molto lontano.

Si narra che nel 1580 un potente mago di Praga, il rabbino Jehuda Loew ben Bezabel, costruì un Golem gigantesco, cui diede vita scrivendogli sulla fronte la parola emet (“verità” in ebraico). Ma, come accade, la creatura sfuggì al suo controllo e invece di servirlo cominciò a distruggere tutto ciò che incontrava. Il mago allora cancellò la prima lettera della parola emet trasformandola in met (cioè “morte”) e il Golem giacque immobile. Jehuda Loew, intimorito dalle possibili conseguenze delle sue manipolazioni, decise di rinunciare ai servigi del Golem e lo nascose nelle soffitte della Sinagoga Vecchia di Praga, dove la leggenda vuole che si trovi ancor oggi.

In quest'impresa s'intrecciano dunque la vertiginosa ebbrezza della creazione e il timore per la creatura, che minaccia di ribellarsi e distruggere l'inesperto demiurgo. Figura potente e suggestiva, il Golem ha ispirato scrittori e registi cinematografici: ricordiamo il romanzo Il Golem (1915) di Gustav Meyrink e i tre film di sapore espressionista di Paul Wegener (1913, 1915, 1920).

Anche nel caso del mostro di Frankenstein la creatura trascende il progetto e si rivolta, suscitando negli uomini angoscia e terrore. La figura del mostro deve la sua popolarità ai numerosi film di cui è stata protagonista, molti interpretati dall’impareggiabile Boris Karloff, ma le sue origini risalgono al romanzo Frankenstein, o il Prometeo moderno di Mary Wollstonecraft Shelley, moglie del grande poeta inglese Percy Bysshe Shelley. Pubblicato nel 1818, il libro narra la storia di un medico, Victor von Frankenstein, che riesce ad animare una creatura che ha composto con pezzi di cadavere. Ma questo mostro, mal riuscito e deforme, infelice e solitario, si ribella alla sua sorte e si trasforma in un pericolo pubblico, fino a trascinare alla morte il suo creatore tra i ghiacci del Polo Nord.

La Shelley intendeva denunciare il delirio di onnipotenza dell’uomo che vuol imitare Dio e si trasforma in un apprendista stregone: a quel tempo, come del resto oggi, certi sviluppi della tecnologia e certe indagini scientifiche erano fonte di preoccupazione e di timore e il mostro era un emblema delle forze che l’uomo scatena senza saperle dominare. Al di là dell’enorme influenza che la figura di Frankenstein ha esercitato nella cultura popolare, che spesso lo scambia per il mostro da lui fabbricato, in tempi recenti questo nome è diventato sinonimo di manipolazione rischiosa e illecita sotto il profilo etico, specie in campo biologico.

Se al cospetto della creatura di Frankenstein la reazione è di terrore, a volte gli umani subiscono invece il fascino degli esseri artificiali: nei racconti di E.T.A. Hoffmann (1776-1822) gli uomini s'innamorano perdutamente di bambole meccaniche, imitazioni perfette della donna, in cui la differenza tra il modello e la sua riproduzione si attenua fino a scomparire, inducendo in inganno anche l'osservatore più attento. Ciò accade anche nel dramma Minnie la candida (1927), di Massimo Bontempelli (musicato nel 1942 da Riccardo Malipiero): alla giovane e ingenua Minnie vien fatto credere che i pesci di un acquario siano imitazioni talmente perfette da risultare indistinguibili dai pesci veri. Inoltre le viene raccontato che esistono anche esseri umani artificiali, che non si distinguono dagli originali e che per di più non sanno di essere imitazioni. Sconvolta, Minnie comincia a sospettare di essere uno di questi manichini e, ossessionata, si uccide. Da una parte dunque la somiglianza perfetta, o quasi, suscitatrice di sgomento, come accade di fronte ai replicanti di Blade Runner, dall’altra la diversità incolmabile del mostro di Frankenstein, dovuta all’imperizia del costruttore, che suscita orrore perché, con un facile slittamento, è interpretata come segno di malvagità.

Questi temi - orgoglio e timore, fascino e orrore, attrazione e diffidenza - sembrano appartenere alla letteratura fantastica o a un passato ormai lontano, eppure a ben guardare sono ancora presenti non solo nelle opere di fantascienza, ma anche nell’immaginario collettivo e nel nostro atteggiamento nei confronti delle tecnologie di punta, in particolare delle “tecnologie della mente” come i computer, l’intelligenza artificiale e specialmente i robot. Ciò sembra confermare il profondo sostrato mitopoietico ed emotivo che ha sempre accompagnato l’attività tecnologica e la nostra interazione con la macchina.

Ma c’è un altro risvolto della costruzione dell’uomo artificiale, che c’interessa in modo particolare: l’aspetto etico, irto di problemi di non facile soluzione, legati soprattutto alla responsabilità del costruttore nei confronti delle sue fabbricazioni. Di fronte alla complessità della creatura e alla sua somiglianza (quasi) perfetta con l’originale, ci si può infatti interrogare sui suoi possibili sentimenti e sulle sue reazioni (per esempio di fronte alla scoperta di essere solo un’imitazione, un po' come quando un figlio adottivo scopre di non essere un figlio biologico).

La psicologia e la sociologia degli automi, dei robot e delle creature ciborganiche costituiscono uno dei filoni più interessanti della moderna fantascienza e uno dei problemi più complessi di un futuro quasi a portata di mano. Perché suscitare dal nulla creature tanto simili a noi da esser capaci di soffrire?

Affronteremo questo problema, non prima tuttavia di aver tracciato una breve storia degli automi, opere artigianali che tentavano di incarnare, sul versante costruttivo, le idee e le aspirazioni narrate nella letteratura. (2-continua)

Dagli automi all'intelligenza artificiale

- 15878 reads

In effetti l'uomo si dimostra essere cosa divina

perché dove la natura finisce di produrre le sue spetie

l'uomo quivi comincia colle cose naturali a fare

coll'aiutorio d'essa natura infinite spetie.

(Leonardo da Vinci)

Da sempre l'uomo nutre la smisurata aspirazione di imitare l'atto divino della creazione. Più o meno dichiarata, quest'ambizione serpeggia in tutta la storia umana e ha ispirato miti, leggende e romanzi di grande suggestione, dal racconto del Golem a quello di Frankenstein. Passando dalla letteratura al versante costruttivo, i tentativi si presentano altrettanto numerosi, anche se i risultati, per la riottosità della materia e per le difficoltà di lavorazione, sono più modesti rispetto ai prodotti della fantasia, ma forse più ammirevoli per la loro concretezza.

Nascono così gli automi: costruzioni meccaniche, fontane semoventi, orologi, organi di varie forme e dimensioni, insomma creature spesso zoomorfe o antropomorfe, che, mosse dalla forza dell’acqua, dal calore o da un meccanismo nascosto al loro interno, sembrano comportarsi come esseri viventi. All'inizio, lo stupore suscitato da questi manufatti si mescolava con la reverenza nei confronti del divino e con l'aspirazione a governare il mondo per via magica. In seguito, questi speciosissimi giocattoli divennero stimolo alla riflessione sulle possibilità tecniche via via scoperte dall'uomo. Da quel momento l'elemento meraviglioso e ludico cominciò ad essere sostituito dalle finalità pratiche: lo scopo dei costruttori di automi, come spiegò il fisico e fisiologo tedesco Hermann von Helmholtz nel 1871, quando la loro stagione d'oro si avviava al crepuscolo, non era più quello di costruire macchine che compiano le mille diverse azioni di un unico uomo, bensì quello di ottenere una macchina che compia un'unica azione, però sostituendo mille uomini.

Questi raffinati e suggestivi prodotti dell'ingegno umano che preludono in forme bizzarre e inusitate alla tecnologia moderna, oggi non si costruiscono più e sono sostituiti ovunque, se non nei musei e nei teatri della nostalgia, da dispositivi in cui l'elettronica si rivela sempre più sollecita dell'efficienza e sempre meno dell'imitazione puntuale della natura. Eppure gli automi, specie quelli antropomorfi, gli androidi e le gineidi, continuano a popolare di inquiete proiezioni e torbidi sogni l’immaginario del nostro tempo e di qui travalicano nelle creazioni artistiche e nelle attuazioni tecniche. Anche se le tecnologie sono mutate, persiste e prospera un settore di ricerca, la robotica, in cui riappare la dubitosa e mutevole linea di separazione tra ciò che l'uomo è e ciò che potrebbe diventare, tra ciò che può attuare e ciò che può solo sognare. In questo senso gli automi e compagnia incarneranno sempre - anche nelle nuove vesti informatiche, robotiche e ciborganiche - l'aspirazione dell'uomo a travalicare i limiti della propria contingenza.

In passato la parabola di quest’avventura è stata scandita dalle epoche corrispondenti ai più celebri costruttori di automi: Ctesibio ed Erone il Vecchio nel mondo alessandrino; i figli di Musà e il sommo al-Jazari all'acme della civiltà araba; la progressiva fioritura di quest'arte nel passaggio dal Medioevo al Rinascimento europeo, culminata nelle opere degli artigiani di Augusta e di Norimberga; fino al Secolo dei lumi, con le anatomies mouvantes di Vaucanson (il flautista, il tamburino, e soprattutto l'anatra digerente, un automa a forma di papera che si moveva qua e là, becchettava chicchi di grano e li digeriva… defecando) e con le bambole perfette dei Jaquet-Droz (lo scrivano, il disegnatore, la sonatrice); per confluire infine nell’arte degli orologiai svizzeri. In questa prospettiva, gli Swatch sono gli ultimi epigoni degli automi.

Accanto ai Golem, alle statue parlanti, ai prodigi e ai mostri delle leggende e della letteratura, gli automi sono dunque i protagonisti di una storia affascinante e tenebrosa di meccanica onirica, dove magia e occultismo s'intrecciano con la genialità inventiva, in un turbinio di personaggi eterogenei: inventori, maghi, affaristi, ciurmadori, studiosi, prestidigitatori e creduloni. Ma su un altro versante la storia di queste creature artificiali, di volta in volta seducenti, preziose, inquietanti e sospette, costituisce un distillato significativo dell'intera storia della tecnica e dell'afflato prometeico che l'ha sempre animata.

I manufatti, pur nella loro stupefacente raffinatezza, restavano comunque lontanissimi dal loro modello, uomo o animale, cui li avvicinava sì la forma esteriore, ma non una puntuale somiglianza strutturale e funzionale. La situazione subì una svolta radicale quando cominciò ad emergere e a prender vigore una corrente di pensiero e di ricerca legata all'informazione, che per secoli era stata quasi del tutto celata dalle più clamorose conquiste relative alla materia e all'energia. Del mondo dell'informazione, che è retto da leggi piuttosto diverse da quelle della fisica, si cominciò ad avere piena consapevolezza solo verso la metà del Novecento, soprattutto grazie alle ricerche stimolate dalla seconda guerra mondiale nel campo dei calcolatori e delle telecomunicazioni. Si vide che energia e informazione, pur non essendo riconducibili l'una all'altra, interagiscono in modi vari e talora sorprendenti. Soprattutto si capì che il calcolatore, lungi dall'essere una semplice macchina per far di conto, possedeva capacità enormi e tutte da esplorare proprio nell'ambito del mondo dell'informazione e della mente. Questa consapevolezza portò, nel 1956, alla nascita di una nuova disciplina, cui fu dato il nome, per la verità, come vedremo, un po' infelice e fonte di equivoci durevoli, di intelligenza artificiale (IA), e il calcolatore divenne il modello di elezione della mente umana.

Risuscitava così in forme nuove la vecchia ambizione di replicare l'atto della creazione, ma non più con l'ingenuo e impossibile intento di costruire una creatura simile all'uomo nel suo complesso, bensì con l’ambizione di riprodurre o simulare con estrema precisione una sua sola parte: la mente. La fantasia cominciava dunque a diventare realtà, sia pure limitatamente a un solo aspetto, ma si trattava dell'aspetto ritenuto più caratteristico dell'uomo: l'intelligenza. Dal Golem, riproduzione perfetta, ma immaginaria, di un uomo, si era passati alla riproduzione, non ancora perfetta, ma perfettibile e concretissima, della mente, cioè del carattere distintivo dell'uomo: dunque, a meno di nostalgie corporee, si era giunti a riprodurre l'uomo tutt'intero.

Ma è proprio a partire di qui che cominciano a profilarsi i problemi più inquietanti della “roboetica”.

(3-continua)

L’altra metà del robot: il corpo

- 14487 reads

Tutto avviene nel corpo, con il corpo e per il corpo, si nasce e si

muore con il corpo, con il corpo si soffre e si patisce e si gode, la vita si

genera con un atto rapido del corpo […].

Che le cose più importanti, l’amore, la vita, il nutrimento, la morte

avvengano per e nel corpo aggiunge mistero al mistero dell’esistenza.

(Giuseppe O. Longo, L’acrobata)

Una tappa fondamentale sulla strada della costruzione dell’uomo artificiale si ebbe, verso la metà del Novecento, con la costruzione del calcolatore elettronico, o computer. Più che una macchina, il computer è una metamacchina: a seconda del programma che gli si fornisce, esso esegue un compito diverso, cioè diventa una macchina diversa. Al contrario delle macchine tradizionali, che elaborano e trasformano energia e materia (si pensi alle locomotive, agli impianti chimici, alle centrali elettriche), il computer elabora e trasforma informazione: dunque è una macchina simbolica e in ciò ha forti somiglianze con la mente umana. Fu dunque abbastanza naturale assumerlo come modello della mente.

Così, nel 1956, nacque negli Stati Uniti una nuova disciplina, cui fu dato il nome, per la verità un po' infelice e fonte di equivoci durevoli, di intelligenza artificiale (IA). L’intento era quello di costruire programmi per computer che riproducessero il funzionamento dell’intelligenza umana. Rinasceva così in forme nuove la vecchia ambizione di costruire l’uomo artificiale, sia pur con riferimento a una sola caratteristica, ma si trattava della caratteristica umana più nobile e distintiva: l'intelligenza.

Si consideravano naturalmente solo gli aspetti logico-formali dell’intelligenza, quelli che il computer sa gestire, ma a quei tempi c'era (e in parte c'è tuttora) una forte tendenza a ridurre l'intelligenza ai suoi aspetti razionali, anzi simbolici e algoritmici, quindi sembrava proprio che il computer, opportunamente programmato, potesse funzionare come la mente: del resto che cosa fa l’uomo quando pensa? Non fa altro che compiere delle operazioni, ovvero esegue delle successioni di istruzioni (degli algoritmi). Questa era l’ipotesi di fondo dell’IA. Che questi algoritmi fossero eseguiti in un cervello o in un computer non sembrava fare differenza: insomma, il supporto, l’hardware, era necessario sì, ma inessenziale: ciò che contava era il software.

Si era dunque creata una doppia metafora: il computer era un cervello (si parlava infatti di “cervello elettronico”) e, viceversa, il cervello era un computer. Si scopriva nel calcolatore un mirabile specchio dell’uomo e si trattava solo di costruire programmi sempre più raffinati. L'informatica era la tecnologia giusta per costruire, dopo tante ingenuità, modelli della mente corretti e collaudabili.

In realtà l’IA si basava su ipotesi non dimostrate e su una fede quasi ideologica nel riduzionismo algoritmico, cioè nella possibilità di rappresentare tutta l’attività mentale dell’uomo mediante l’esecuzione di catene più o meno lunghe di istruzioni. Questa congettura, non dimostrata e forse non dimostrabile, fu accettata da molti e pose le premesse teoriche e la giustificazione filosofica della versione forte dell'IA. Secondo questa versione, è possibile trasferire, senza perdite e senza distorsioni, da una struttura (cervello) a un’altra (computer) la funzione (cioè i programmi e gli algoritmi), che è la vera essenza dell’intelligenza. Si parla perciò di funzionalismo.

L’IA funzionalistica incontrò subito un certo successo: in logica, in matematica, nei giochi, insomma nei problemi di carattere formale, gli algoritmi costruiti da schiere di entusiasti programmatori si dimostrarono efficienti o almeno promettenti. Ma dopo i primi esiti lusinghieri, anche i sostenitori più ferventi del funzionalismo dovettero riconoscerne i limiti, che derivano dalla natura disincarnata della mente artificiale, cioè dall’assenza di un corpo che comunichi con l’ambiente. Se l’intento era quello di simulare l’intelligenza umana, il riduzionismo mentalista dell’IA funzionalista ne trascurava un elemento essenziale, l’immersione nell’ambiente.

Col passare del tempo si scopriva che l’IA era molto diversa da quella umana, tanto che la locuzione “intelligenza artificiale” si rivelava sempre più equivoca: l’elaborazione simbolica delle macchine era caratterizzata molto più dall’aggettivo “artificiale” che dal sostantivo “intelligenza”. La differenza fondamentale era costituita dalla presenza, nell’uomo, del corpo, che invece era assente nell’IA.

L'intelligenza umana (e animale) si costituisce e si manifesta attraverso il contatto e l’interazione con l’ambiente. L’intelligenza è un insieme di caratteristiche e attività fortemente sistemiche, oltre che fortemente evolutive. In particolare, l'intelligenza nasce, si sviluppa e si manifesta attraverso la comunicazione, cioè lo scambio di messaggi di vari tipi, entro vari contesti, in vari codici e a vari livelli. Poiché la nostra “interfaccia” con il resto del mondo è costituita dal corpo e dagli strumenti tecnologici che via via costruiamo e perfezioniamo, e che del corpo sono un'estensione e un potenziamento, è chiaro che proprio al corpo spetta il compito determinante di consentire la comunicazione e di filtrarla, sia in ingresso (organi di senso) sia in uscita (muscoli e ossa), cioè conoscenza e azione.

Riconosciuto il limite essenziale dell’IA funzionalistica e proseguendo sulla strada dell’imitazione della natura, per avvicinare l’uomo artificiale al suo modello naturale si pensò di dotare il cervello artificiale di un corpo artificiale, capace di ricavare informazioni dall’ambiente e di agire in esso: questa strada portò alla nascita del robot. Alla base di questa svolta c’è il riconoscimento della funzione conoscitiva del corpo.

Il sistema o macchinario gnoseologico, cioè conoscitivo, dell’uomo ha due modalità essenziali di funzionamento. La prima, più arcaica sotto il profilo sia della specie sia dell’individuo, è la conoscenza tacita, globale e immediata attuata dal corpo e nel corpo, nella sua struttura e nelle sue funzioni biologiche, e guidata dal sistema affettivo ed emotivo. La seconda, più recente sotto il profilo evolutivo e posteriore nello sviluppo dell'individuo, è la conoscenza esplicita, attuata nelle forme verbali e della razionalità. Insomma, semplificando brutalmente, da una parte la conoscenza corporea, dall’altra la conoscenza mentale.

Orbene, la storia della scienza occidentale è in fondo un lungo tentativo di trasferire le conoscenze dalla prima alla seconda modalità, cioè dalla conoscenza biologica incarnata nel corpo (corpo che a sua volta è immerso nell'ambiente) a una razionalità disincarnata. In altre parole si vorrebbe tradurre nello scarnificato linguaggio astratto della mente (in particolare nel simbolismo della matematica) le rigogliose strutture del corpo, della natura e del mondo; si vorrebbe insomma rendere esplicito, consapevole e leggibile ciò che è implicito, inconsapevole e oscuro.

Trasferito nel terreno della mente, questo tentativo culminò nell'impostazione funzionalista o fisico-simbolica dell'IA. Ma fino a che punto è possibile il trasferimento? All'inizio si riteneva che tutte le conoscenze fossero trasferibili, ma dopo i primi entusiasmi vennero le delusioni e oggi ci si rende conto che se vogliono replicare più o meno da vicino l'intelligenza umana anche le “macchine intelligenti” non possono fare a meno dell'equivalente di un corpo con tutta la sua attività cognitiva profonda e in parte forse non algoritmica. L'intelligenza disincarnata è troppo fragile e limitata.

Insomma il tentativo di tradurre in conoscenza alta, razionale ed esplicita la massa delle conoscenze materiali, corporee e implicite incappa nell'ostacolo tipico di ogni processo di traduzione, cioè l'incompletezza. Rimane sempre un residuo ostinato e ribelle, che non si può tradurre.

Appare così giustificato in termini epistemologici il passaggio dall’IA funzionalistica all’IA incorporata nel robot. Il robot, sotto questo profilo, si presenta come un corpo artificiale dotato di una mente artificiale e non come una mente artificiale disincarnata e isolata dal mondo. Il futuro della robotica più ambiziosa, quella che mira alla costruzione di macchine dotate di intelligenza, emozioni e forse, udite!, coscienza, potrebbe dunque dipendere dalla comprensione del significato cognitivo delle azioni semplici, incarnate e immerse nel contesto ambientale che compiamo di continuo nella vita di tutti i giorni. Le descrizioni e gli strumenti usati in IA sono “alti e deboli”: occorre integrarli con descrizioni e strumenti “bassi e forti”, che riflettano e riproducano il nostro enigmatico e struggente “esserci nel mondo”. Vedremo le possibili conseguenze di questa svolta epocale. (4-continua)

Roboetica, l'urgenza di una riflessione

- 15434 reads

Attorno al mese di

dicembre del 1910 le caratteristiche

dell'uomo cambiarono

(Virgina Woolf)

I possibilisti vivono in

una tessitura più sottile, una tessitura di fumo, immaginazioni, fantasticherie e

congiuntivi

(Robert Musil)

Nelle puntate precedenti abbiamo passato rapidamente in rassegna la storia della robotica. Mentre l'evoluzione biologica ha dotato gli organismi viventi prima di un corpo e poi di un cervello, avente funzioni di controllo centrale e dotato, negli organismi più complessi, di proprietà cognitive superiori, l'intelligenza artificiale funzionalistica è partita dal cervello e ha tentato di costruire una mente senza corpo, cioè un'intelligenza che imitasse le funzioni superiori, simboliche e astratte, del cervello biologico evitando ogni interazione con un ambiente considerato fonte di disturbo. Tuttavia la difficoltà di estendere questa forma d'intelligenza artificiale al di fuori dei domini simbolico-formali ha fatto ritenere che soltanto accoppiando la mente artificiale all'ambiente attraverso un corpo artificiale, dotato di sensi e di organi attuatori, si potesse ottenere un'intelligenza flessibile e ad ampio spettro analoga a quella biologica.

Benché in questo ambito gli scenari sconfinino spesso nella fantascienza, essi rispecchiano tendenze e problemi che da una parte sono sempre più vicini alla realtà della vita quotidiana e dall’altra tendono a improntare di sé molte ricerche nell’ambito dell’intelligenza artificiale, della robotica, della protetica, dell’ibridazione nanometrica. E’ alla luce di questi sviluppi e di queste tendenze che si devono considerare le prospettive aperte dalla robotica e dalla presenza dei robot tra noi. I robot lavorano con noi e per noi, e questa collaborazione per il momento ha il carattere di una dipendenza unidirezionale, ma in un qualsiasi momento essa potrebbe assumere natura paritaria o quasi per i continui progressi tecnici. La distinzione, oggi chiarissima, tra uomo e robot tende ad attenuarsi, l’antropologia tende a confondersi con la “robotologia”.

A questo proposito si prospetta il vasto problema della sostituibilità del robot all’uomo, problema che fu già affrontato dal filosofo e matematico Norbert Wiener quando si rese conto delle possibili implicazioni della tecnologia dell’informazione. Ma la riflessione filosofica risale addirittura a Kant, che pose un chiaro divieto all’uso strumentale dell’essere umano. Il problema della sostituibilità presenta un aspetto tecnico (si tratta di valutare il rapporto mezzi-fini in un contesto specifico); un aspetto economico (rapporto costi-benefici, che nel caso dei robot di servizio, badanti, camerieri e così via, potrebbe comprendere una valutazione più soggettiva, legata alla cortesia, alla gradevolezza, all’estetica); un aspetto legale (d’importanza cruciale è l’attribuzione della responsabilità di un danno provocato da un robot nell’interazione con una persona). E infine: esistono settori in cui l’integrazione o la sostituzione sia da escludere? Questa domanda apre alla prospettiva etica nel senso kantiano, che ha a che fare con la dignità e con i fini e che a sua volta dovrebbe essere la base per le decisioni politiche e, in ultima istanza, anche tecniche.

Tra gli specialisti è diffusa l’opinione (spesso irriflessa) che l’introduzione nel nostro mondo di macchine intelligenti (qualunque sia il significato di questo aggettivo) e la sostituzione degli esseri umani con queste macchine portino benefici generalizzati alla società. Questa opinione dovrebbe confrontarsi con un fatto che è sotto gli occhi di tutti: sempre più le innovazioni assumono un carattere imperativo. Cioè si diffondono in base a una motivazione implicita e intrinseca, di carattere tecnico-economico, e non perché una discussione aperta e democratica tra i vari soggetti e attori sociali abbia stabilito che sono vantaggiose, magari dopo un periodo di assestamento in cui certi settori potrebbero risultare danneggiati.

Poiché la tecnologia avanza con velocità crescente, è opportuno dedicare attenzione a questi problemi, che sono complicati dal fatto che nel rapporto uomo-macchina è l’uomo che, per la sua flessibilità, di solito si adatta alla tecnologia, e non il contrario. Questo adattamento comporta trasformazioni antropologiche che da alcuni sono state assimilate, impropriamente, a una “disumanizzazione”. In realtà si tratta di modifiche di tipo evolutivo, e ve ne sono sempre state: la natura umana, a lungo considerata fissa, non lo è affatto e subisce modificazioni continue anche per effetto della tecnologia. I problemi indotti dalla stretta interazione, o meglio dalla vera e propria simbiosi tra l’uomo e la macchina sono di natura non solo cognitiva, culturale o sociale, ma, anche e squisitamente, etica.

E’ abbastanza singolare che il dibattito etico si accenda intorno alle innovazioni biologiche, genomiche e procreative, mentre sul fronte delle tecnologie basate sull’intelligenza artificiale, come la robotica, si osserva un'accettazione passiva delle possibili conseguenze. Ma gli effetti delle macchine intelligenti sono di vasta portata ed esercitano una forte pressione sull’etica. Il problema etico, già di per sé arduo nel mondo di oggi, viene complicato da questi nuovi attori che sono i robot: è importante capire che cosa si fa, come lo si fa e perché lo si fa, tenendo conto, per quanto possibile, delle conseguenze delle scelte compiute oggi, conseguenze che potrebbero dimostrarsi irreversibili. E’ un richiamo alla nostra responsabilità, che a sua volta deriva da una consapevolezza che ormai si fa strada tra i ricercatori più avvertiti.

Per le considerazioni che intendo svolgere sui robot e sulla roboetica, sarà utile prendere spunto dalla fantascienza, che costituisce un importante laboratorio di scenari suscettibili di trasformarsi in realtà, se non nei particolari certo almeno nei tratti generali. Nel caso dei robot la letteratura e la filmografia sono ricchissime di spunti. La psicologia e la sociologia dei robot, degli androidi, delle gineidi e dei ciborg (o cyborg, all’inglese) sono uno dei temi più interessanti della fantascienza contemporanea e si annunciano come uno dei settori più problematici di un futuro già a portata di mano nell’ambito della robotica. Scrittori e registi hanno indagato con slancio e inventiva il rapporto uomo-macchina, indicandone i possibili sviluppi e i nodi prossimi venturi, a cominciare – per non risalire troppo indietro nel tempo e per citarne solo alcuni – dal dramma R.U.R. - Rossum's Universal Robots del boemo Karel Čapek (1920), passando per i racconti di Isaac Asimov dedicati ai robot, fino a film come 2001: Odissea nello spazio, AI: Intelligenza Artificiale, Blade Runner e moltissimi altri ancora. (5-continua)

Perchè si fabbricano i robot?

- 17481 reads

Helena:

Perché li fabbricate, allora?

Busman: Ahahah! Questa è bella! Perché

si fabbricano i Robot!

Fabry: Per il lavoro, signorina. Un

Robot sostituisce due operai e mezzo. La macchina umana, signorina, era molto

imperfetta. Un giorno occorreva eliminarla definitivamente.

(Karel Čapek, R.U.R.)

Il termine “robot” (dal vocabolo ceco rab, schiavo, connesso con il russo rabota, lavoro) fu introdotto nel 1920 dallo scrittore ceco Karel Čapek nel suo dramma “R.U.R.” (Rossum’s Universal Robots), – rappresentato il 25 gennaio 1921 al Teatro nazionale (Národní Divadlo) di Praga – a indicare una macchina antropomorfa progettata e costruita dall’ingegner Rossum (da un’altra radice slava, rasum, ragione, intelligenza) per alleviare le fatiche degli umani. (Quindi la pronuncia corretta di robot è ròbot, e non robò, alla francese.)

Nel dramma si ritrovano molti dei temi relativi al rapporto uomo-robot: la compassione di Helena, che li ritiene infelici e vorrebbe promuoverne il riscatto dotandoli di anima; il realismo di Domin che li considera semplici macchine, prive di ogni sensibilità e destinate a servire indefessamente gli umani; il cinismo di Gall, che le vorrebbe capaci di soffrire per aumentare il loro rendimento; la ripugnanza di Nana, che vede in loro l’opera del demonio; gli effetti perversi della loro laboriosità, che porta gli uomini ad affogare nell’ozio e le donne a non partorire più; il loro impiego militare contro gli operai in rivolta per aver perso il lavoro.

Per opera degli scienziati, i robot di Čapek progrediscono e diventano sempre più intelligenti, superando gli uomini. Quando se ne rendono conto, i robot di tutto il mondo si ribellano ed eliminano la razza umana per assumere il potere; così facendo tuttavia si condannano alla scomparsa, perché senza gli uomini non sanno riprodursi. Ma due robot di tipo specialissimo, maschio e femmina, hanno ricevuto dai costruttori scomparsi la capacità di amare e di procreare e dànno origine a una nuova stirpe.

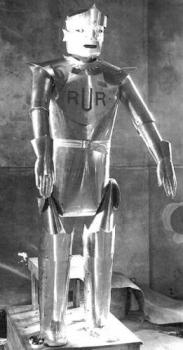

Un robot della versione

cinematografica di R.U.R.

Tutto è bene ciò che finisce bene, ma nel dramma di Karel Čapek riaffiora potente il tema della ribellione della creatura nei confronti del creatore, che è una costante dei rapporti uomo-tecnologia e ha molti precedenti nella tradizione mitologica e letteraria, a cominciare dalla ribellione di Adamo ed Eva. L’inquietudine derivante dalla possibile insubordinazione affiora anche oggi, forse perché i robot ci imitano nelle funzioni e nel comportamento e potrebbero un giorno diventare nostri concorrenti.

La somiglianza delle forme acuisce l’inquietudine: un robot a forma di frigorifero non c’impressiona quanto un umanoide, anche se meno “intelligente” del primo. All’umanoide tendiamo ad attribuire caratteristiche umane (intelligenza, sentimenti...) che esiteremmo a concedere ai robot non antropomorfi. Le suggestioni derivanti dalla somiglianza esteriore di forma sono fortissime e formano un cortocircuito destabilizzante quando si scontrano con la consapevolezza che ci si trova di fronte a una macchina.

Ciò che si sa per via razionale rischia di essere spazzato via dalla proiezione emotiva: il robot viene umanizzato grazie a un meccanismo simile a quello che ci fa attribuire alle menti altrui, inaccessibili, le stesse proprietà della nostra mente, che ci è un po’ più accessibile. Ma se per le menti altrui la proiezione è giustificata da una potente analogia basata sulla comune origine biologica, sulla comune esperienza esistenziale e sulla pratica comunicativa, per i robot si tratta di una sorta di animismo, un’estensione ai manufatti artificiali dell’antropomorfizzazione che esercitiamo da sempre nei confronti dell’alterità (per esempio divina o animale).

Per esempio è difficile sottrarsi al fascino di Valerie (vedi figura), pur sapendo razionalmente che si tratta di un robot: su di "lei" proiettiamo una costellazione di emozioni di tipo estetico-erotico che sono giustificate solo dal suo aspetto esteriore, ma che sono potentissime.

Valerie,

un robot umanoide

Ciò conferma quanto siamo sensibili alle sembianze delle creature che ci circondano: l’estetica è sempre stata una guida importante per le nostre azioni e per le nostre scelte (per esempio in campo sessuale e procreativo). Inoltre etica ed estetica sono legate a doppio filo: ciò che è bello ci appare spesso anche buono e viceversa (l’endiadi greca kalòs kài agathós, bello e buono, la dice lunga). Etica ed estetica affondano le loro radici nella nostra storia evolutiva, anzi nella coevoluzione tra noi e l’ambiente.

Propongo le seguenti definizioni naturalistiche, che si basano su un’impostazione sistemica simile a quella di Gregory Bateson:

- L’estetica è la percezione soggettiva (ma condivisa, dunque intersoggettiva) del nostro legame con l’ambiente, legame caratterizzato da una profonda ed equilibrata armonia dinamica.

- L’etica è la capacità, soggettiva e intersoggettiva, di concepire e compiere azioni capaci di mantenere sano ed equilibrato il legame con l’ambiente.

Etica ed estetica sono quindi due facce della stessa medaglia perché derivano dalla forte coimplicazione evolutiva tra specie e ambiente e sono entrambe “rispecchiamenti” in noi di questa coevoluzione. Se l'estetica è il sentimento (inter)soggettivo dell'immersione armonica nell'ambiente e l'etica è il sentimento (inter)soggettivo di rispetto per l'ambiente e di azione armonica con esso, allora l'etica ci consente di mantenere l'estetica e l'estetica ci serve da guida nell'operare etico. In questa impostazione, l'etica e l'estetica sono entrambe dinamiche, cioè sottoposte a un processo storico evolutivo.

Vedremo la prossima volta quali conseguenze possano avere queste definizioni su concetti basilari quali il libero arbitrio, la responsabilità e la coscienza. (6-continua)

Etica, estetica e libero arbitrio

- 54551 reads

Evodio: So con certezza che altro è vivere ed altro esser

coscienti di vivere.

Agostino: Quale ti sembra

più elevato?

Evodio: Certamente la

coscienza di vivere.

(Sant'Agostino)

Nella precedente puntata di questo nostro viaggio nella robotica ho proposto una definizione operativa, anche se discutibile, di estetica e di etica:

- L’estetica è la percezione soggettiva (ma condivisa) del nostro legame con l’ambiente, legame caratterizzato da una profonda ed equilibrata armonia dinamica.

- L’etica è la capacità, soggettiva e intersoggettiva, di concepire e compiere azioni capaci di mantenere sano ed equilibrato il legame con l’ambiente.

Etica ed estetica sono quindi due facce della stessa medaglia perché derivano dalla coimplicazione evolutiva tra specie e ambiente e sono entrambe “rispecchiamenti” in noi di questa coevoluzione. Se l'estetica è il sentimento (inter)soggettivo dell'immersione armonica nell'ambiente e l'etica è il sentimento (inter)soggettivo di rispetto per l'ambiente e di azione armonica con esso, allora l'etica ci consente di mantenere l'estetica e l'estetica ci serve da guida nell'operare etico.

Al tema dell'etica si legano altri concetti importanti: la libertà, la responsabilità, la dignità e così via, che si possono raggruppare intorno al tema formidabile e controverso del libero arbitrio. Alcuni risolvono sbrigativamente il problema negando la libertà non solo ai fenomeni naturali, ma anche all'uomo, sulla base di un feroce determinismo di stampo fisicalista, alla Laplace.

Secondo questa visione, io starei scrivendo queste cose non perché voglio comunicarle, ma perché i miei neuroni si trovano in un certo stato. Bisognerebbe a questo punto spiegare perché i miei neuroni si trovano in questo stato, e poi bisognerebbe trovare una causa a questa causa, e così via. D'altra parte l'asserzione “voglio comunicare queste cose” è altrettanto problematica.

Altri, all'opposto, negano la libertà riconducendola alla pura casualità: così io scriverei ciò che scrivo per caso, ma potrei anche scrivere cose molto diverse o addirittura opposte... Qui la difficoltà è quella di dare una spiegazione coerente e persuasiva del “caso”, ma in oltre duemila anni di sforzi i filosofi e gli scienziati non ci sono riusciti pienamente. Per alcuni il caso è uno dei nomi della nostra ignoranza delle cause soggiacenti, che sarebbero sempre ben precise; per altri il caso è una caratteristica ineliminabile della natura, non riconducibile al determinismo, come sembra indicare la meccanica quantistica nella sua formulazione ortodossa.

Comunque, sia i deterministi sia i probabilisti negano la libertà, quindi negano la responsabilità, che è uno dei pilastri del nostro vivere in società: non solo le religioni più diffuse ma anche le legislazioni di (quasi) tutti i Paesi postulano il libero arbitrio, quindi la responsabilità e la punibilità rispettivamente del peccato o del reato. Inoltre la percezione soggettiva del libero arbitrio, almeno in molte situazioni, è inoppugnabile e fornisce un indizio importante del legame tra libertà, responsabilità, etica e coscienza.

Etica, coscienza e morale

Non è male perché è vietato dalla legge,

ma è vietato dalla

legge perché è male

Sant'Agostino

Si potrebbe, in questo senso, sostenere che solo le creature dotate di coscienza posseggono il libero arbitrio e sono in grado di agire in modo etico. Il problema, quindi, si complica ancora di più, stante la confusione che regna a proposito della coscienza.

Non è certo un caso che siano in corso ricerche per dotare i robot di una coscienza artificiale, CA, la cui definizione operativa potrebbe essere: un robot è dotato di CA se si comporta in modi che, negli umani, richiedono coscienza (è una definizione in un certo senso analoga a quella dell'intelligenza artificiale, IA). Come si possa introdurre la CA in un robot resta molto oscuro, anche perché non abbiamo un'idea precisa di che cosa sia la nostra coscienza, di come sia nata e della sua funzione. Si potrebbe concepire uno speranzoso procedimento basato sulla'emergenza: costruendo un artefatto che sia abbastanza complesso e che abbia con l'ambiente un'interazione abbastanza articolata e composita, si può forse immaginare che a un certo punto in esso si accenda la scintilla della coscienza... Ma queste sono speculazioni.

Resta il fatto che postulando un legame tra etica e coscienza, si porrebbero molti limiti all'eticità dell'agire animale: di fatto molti negano che gli animali siano in grado di valutare le proprie azioni, attribuendo loro significato etico, e distinguono quindi tra azione e sua valutazione. Le azioni di per sé non sarebbero etiche, solo le valutazioni lo sarebbero. La mia definizione di etica invece prescinde tendenzialmente dalla valutazione: etico è ciò che fa bene al sistema complessivo, dove “far bene” significa “mantenere le condizioni di equilibrio dinamico”, cioè mantenere il sistema complessivo sano ed equilibrato, cioè capace di continuare a sussistere, a “vivere”.

Consideriamo la

vita: in primo luogo la vita si mantiene in vita. L'indefessa e continua

attività degli organismi viventi è rivolta a mantenere le condizioni in cui

quell'attività può continuare a svolgersi. Ciò che mantiene la vita, dunque, è

etico. Per sottolineare il carattere “naturalistico” dei principi etici da me

postulati, li si può far discendere da un'istanza primigenia di conservazione

della vita (nel senso più generale), sia individuale sia collettiva sia

sistemica. La conservazione della vita sistemica comporta la percezione e poi

l'esplicitazione di un'etica ambientale, di cui ormai tanto si parla.

L’etica tradizionale è più ristretta di quella proposta qui, poiché si limita a

considerare i rapporti tra esseri umani. In questo senso le religioni hanno

costruito etiche codificate (le morali) basate sul rapporto con la divinità o sui

rapporti interpersonali, ancora mediati o imposti dalla divinità, in cui hanno

luogo i concetti di bene e di male in quanto dettati dalle leggi divine, eterne

e immutabili.

E’ anche interessante notare che l’attenzione quasi esclusiva che la morale religiosa ha per gli umani ha portato col tempo e con progressive dosi di desacralizzazione, al concetto di persona, all’idea di dignità dell’uomo, e alla formulazione di vari codici o statuti dei diritti dell’umanità.

Non voglio affatto sminuire la portata di queste conquiste, anzi forse se ci si limitasse all’impostazione naturalistico-evolutiva da me proposta non si riuscirebbe a fare il salto qualitativo compiuto dalla morale religiosa e incorporato nella legislazione di molti Paesi. Tuttavia, come ho detto, l’attenzione per l’uomo è oggi affiancata da una crescente attenzione per alterità non umane, per esempio per gli animali e per l’ambiente, attenzione che, pur tra molte resistenze, recupera in parte la radice naturalistico-evolutiva dell’etica.

E’ in questo quadro

allargato che si può immaginare di elaborare un’etica che comprenda anche i

rapporti tra uomo e robot, oggi in sede speculativa, ma tra pochissimo tempo

anche in pratica.

Infatti l’equilibrio del sistema complessivo, di cui facciamo parte, e che sta

alla base della mia definizione di etica e di estetica, è dinamico, non certo

statico: perciò etica ed estetica sono storiche ed evolutive e dipendono anche

dagli oggetti artificiali che l’uomo costruisce e che sempre più concorrono a

formare l’ambiente in cui viviamo.

Di questo ambiente cominciano a far parte anche i robot, quindi è inevitabile che essi influiscano sulle nostre percezioni estetiche e sui nostri valori etici, dunque sul complesso dei nostri comportamenti. (7-continua)

Le leggi di Asimov, riscritte dal robot

- 44131 reads

«Che siamo fatti di carbonio o di silicio

non ha importanza: ciascuno di noi dev’essere trattato col giusto

rispetto»

(Arthur C. Clarke, 2010).

Esaminiamo ora il concetto di “roboetica”, cercando di esplicitarlo nei suoi significati possibili. Dalle considerazioni fatte nelle puntate precedenti emerge una prima accezione, molto generale: “roboetica” è semplicemente “l’etica nell’epoca dei robot”, cioè l’insieme dei comportamenti dell’umanità (e la valutazione di questi comportamenti) quando dell’ambiente in cui vivono gli uomini facciano parte anche i robot.

Ma “roboetica” potrebbe anche significare l’insieme (più ristretto del precedente) di quei nostri comportamenti nei confronti dei robot che consentono di mantenere un giusto equilibrio dinamico tra noi e loro.

Poiché i robot posseggono una certa autonomia e una certa capacità di apprendere dall’esperienza, “roboetica” può anche indicare l’insieme dei comportamenti utili, o almeno innocui, dei robot nei nostri confronti. Infine, ed è il significato più avveniristico, potrebbe significare il complesso dei comportamenti che i robot adottano tra loro e verso il loro ambiente, di cui fanno parte anche gli umani.

Riassumendo, la roboetica può significare:

- L’etica umani -> ambiente (ambiente in cui ci sono altri umani e anche i robot).

- L’etica umani -> robot.

- L’etica robot -> umani.

- L’etica robot -> ambiente (ambiente in cui ci sono anche i robot e gli umani).

Mi rendo conto che si tratta di definizioni approssimative e discutibili, ma da qualche parte bisogna pur cominciare.

La terza accezione si deve conformare al precetto generale e tradizionale per cui le macchine non debbono danneggiarci (primum non nocere). E' certo questa accezione che aveva in mente Isaac Asimov quando propose le sue famose “Tre Leggi della Robotica”, le quali, cablate in modo inestirpabile nel cervello positronico dei robot, dovrebbero garantirci dai loro comportamenti ostili e dannosi:

- Prima Legge della robotica. Un robot non può recar danno a un essere umano e non può permettere che, a causa di un suo mancato intervento, un essere umano riceva danno.

- Seconda Legge della robotica. Un robot deve obbedire agli ordini impartiti dagli esseri umani, purché tali ordini non contravvengano alla Prima Legge.

- Terza Legge della robotica. Un robot deve proteggere la propria esistenza, purché la sua autodifesa non contrasti con la Prima o con la Seconda Legge.

Asimov attribuì le Tre Leggi allo scrittore di fantascienza John W. Campbell a seguito di una conversazione avuta con lui un paio di giorni prima del Natale 1940. Ma, secondo Campbell, Asimov aveva già in testa le leggi, che avevano solamente bisogno di una formulazione esplicita.

Benché Asimov avesse fissato la data di creazione delle leggi, il loro progressivo ingresso nelle sue opere richiese un periodo di tempo piuttosto lungo. Così nel 1941 Asimov scrisse due racconti senza menzionare esplicitamente le Tre Leggi, le quali apparvero insieme esplicitamente nel racconto Girotondo del 1942.

Le Tre Leggi si presentano semplici, chiare, univoche: dovrebbero bastare per regolare perfettamente almeno il punto c). In realtà quando le regole di Asimov fossero calate nel mondo reale non mancherebbero di suscitare problemi e ambiguità. Che cosa vuol dire “danno”? E chi lo stabilisce, chi lo quantifica? Chi ne è responsabile? Il concetto di danno sembra legato al concetto di male (non solo fisico) e sul problema del male si sono arrovellate generazioni di filosofi, teologi, letterati e artisti. Il cervello positronico, razionale e rigoroso, saprebbe impostare e risolvere le “equazioni del male” grazie a un’edizione aggiornata del calculemus leibniziano, secondo cui ogni problema trova una soluzione qualora se ne sappiano impostare i termini in modo rigoroso e quantitativo? C’è da dubitarne...

In effetti la nozione di danno che compare nelle Leggi presenta molte ambiguità: se un umano sta per recare danno a un altro essere umano (per esempio sta tentando di ucciderlo), come si deve comportare il robot? Se interviene reca danno all’assassino, ma il suo mancato intervento reca danno alla vittima.

Inoltre noi uomini siamo contraddittori: come si deve comportare un robot che riceva un ordine contraddittorio (dallo stesso uomo o da due uomini diversi) che sotto il profilo logico metta in crisi il suo sistema di valutazione? Di fronte a una contraddizione gli umani se la cavano quasi sempre con scelte che li fanno “uscire dal sistema” all’interno del quale si annida la contraddizione. Ma questa evasione può avvenire grazie a una certa dose di irrazionalità o di follia creativa. Per consentire al robot di non paralizzarsi di fronte a una contraddizione, si potrebbe forse immaginare di iniettargli un pochino di pazzia, ma con quali conseguenze?

Si può continuare a speculare: se si affidasse lo sviluppo della “specie” robot a un processo evolutivo analogo a quello biologico (o a quello bio-culturale), essi potrebbero compiere - in sostanza fuori del nostro controllo - progressi tali da consentir loro valutazioni etiche più raffinate e precise delle nostre. Per esempio potrebbero, prima o poi, cavarsela meglio di noi in tema di bene e di male (anche se il bene e il male sono sempre riferiti a un soggetto: bene per chi? male per chi?) e potrebbero sviluppare una “teodicea” più rigorosa e soddisfacente della nostra, cioè potrebbero avvicinarsi alla soluzione di un problema teologico e metafisico che ci assilla da sempre: se il creatore del nostro mondo è bontà infinita, perché nel mondo c’è il male? E i creatori del mondo, per i robot, potremmo essere noi...

Ma a quel punto dovrebbero ancora sottostare alla Prima Legge, una legge formulata da creatori imperfetti, incapaci di costruire un mondo privo di male e di insanabili contraddizioni? Oppure sarebbero loro a dettarci leggi nuove e ad assumere il bastone del comando, come solerti genitori nei confronti dei loro vivaci e stolti frugoletti? Del resto nel film 2001: Odissea nello spazio il calcolatore Hal 9000 si comporta proprio così: prende il comando della nave e tenta di uccidere gli umani che intralciano il compimento della missione, invertendo l’ordine d’importanza delle Leggi, cioè subordinando la Prima e la Seconda alla Terza.

Asimov si era certo posto problemi di questo tipo, tanto che in seguito, in un racconto del 1950, Conflitto evitabile, aggiunse la Legge Zero:

- Legge zero della robotica. Un robot non può recar danno all’umanità e non può permettere che, a causa di un suo mancato intervento, l’umanità riceva danno.

Questa Legge suppletiva è interessante per il suo carattere “meta” e conferma che le prime tre non sono sufficienti a costituire un’etica di tipo c) sicura. Infatti se un folle minacciasse la distruzione in massa dell’umanità, la Legge Zero autorizzerebbe il robot a eliminarlo, cioè lo autorizzerebbe a infrangere la Prima Legge. Si apre qui il problema della valutazione quantitativa dei danni, ragionevole anche se molto discutibile secondo la morale tradizionale: l’uccisione di molti è (sarebbe) più grave dell’uccisione di uno.

Ma neppure con quest’aggiunta le leggi di Asimov riuscirebbero a proteggerci da comportamenti robotici dannosi, perché le conseguenze ultime di un’azione, pur rispettosa delle Quattro Leggi, potrebbero alla lunga essere nocive per l'umanità o per singoli esseri umani. Infatti l’analisi di queste conseguenze di lunga portata sfiderebbe la più potente intelligenza (naturale o artificiale) immaginabile: troppe sono le ramificazioni e le interazioni con la mutevole complessità del reale. Sappiamo benissimo che anche le azioni umane dettate dalle migliori intenzioni del mondo sfociano spesso in disastri.

Inoltre ci si può chiedere: per valutare se un’azione sia stata buona o cattiva quando ci si deve arrestare nell'esame della catena delle sue conseguenze? Nella società umana solo alcune azioni “cattive” sono giudicate tali esplicitamente e sono sanzionate in un momento preciso grazie a un procedimento giudiziario che interrompe (o almeno vorrebbe interrompere) la catena delle causazioni.

La maggior parte dei nostri atti non sono oggetto di giudizio formale a un istante dato e continuano a provocare conseguenze, positive e negative, nel mondo ben al di là delle nostre intenzioni e per un tempo potenzialmente illimitato. (8 - continua)

La legge del robot soldato

- 13915 reads

A quale crocevia l’evoluzione in noi umani ha

imboccato la strada sbagliata, al punto che abbiamo associato il soddisfacimento

del piacere alla spinta alla distruzione?

(Christa Wolf, Guasto)

Secondo me non ci siamo arrivati: è innato

nella nostra specie. Il desiderio di distruzione è così radicato in noi che

nessuno riesce ad estirparlo. Fa parte della costituzione di ognuno, giacché il

fondo dell’essere stesso è certamente demoniaco. Il saggio è un distruttore

placato, in pensione. Gli altri sono distruttori in servizio.

(E.M. Cioran, Dell’inconveniente di essere nati)

Abbiamo visto come la presenza tra noi di robot sempre più raffinati e intelligenti apra una serie di problemi etici, che nel loro complesso costituiscono un settore di indagine nuovo e importante, la roboetica. Un esempio già attuale di problema roboetico è rappresentato dall’uso in guerra dei “robot soldato”, cioè di robot costruiti, addestrati e impiegati in azioni belliche, con lo scopo precipuo di uccidere i nemici (uomini).

Nella puntata precedente abbiamo elencato le Leggi della robotica di Asimov. Ora la Prima Legge (Un robot non può recar danno a un essere umano e non può permettere che, a causa di un suo mancato intervento, un essere umano riceva danno) impedirebbe ai robot di partecipare ad azioni di guerra contro esseri umani, mentre oggi molte ricerche mirano proprio alla costruzione di robot soldato.

Il comportamento distruttivo di questi robot sembrerebbe trovare qualche giustificazione nella Legge Zero (Un robot non può recar danno all’umanità e non può permettere che, a causa di un suo mancato intervento, l’umanità riceva danno), che li autorizzerebbe a recare un danno limitato (a uccidere alcuni umani) a chi vuole provocare danni gravi, o addirittura ultimi e irreversibili (uccidere tutti gli umani). Naturalmente, in questo contesto, ha una grande importanza la distinzione tra umani amici (che valgono moltissimo) e umani nemici (che valgono poco o punto). S’intravvede qui una scala quantitativa dei danni, che relativizza il carattere in apparenza assoluto delle prime Tre Leggi e conferma la difficoltà della loro applicazione.

Osserviamo che le ricerche sui robot da guerra s’inseriscono nel quadro del combattimento a distanza, che da sempre ottunde la pietà nei confronti del nemico e aumenta l’efficienza bellica (le due cose vanno di pari passo). Infatti l’inserimento tra me e il nemico di un robot soldato aggiunge alla distanza fisica un distanza psicologica che colora la battaglia di indifferenza, di cinismo e di irresponsabilità. Quest’ultimo punto è forse il più importante: delegando al robot l’uccisione del nemico, l’uomo si scaricherebbe in buona parte della responsabilità del sangue versato. Ma fino a che punto la responsabilità di un’azione criminosa può ricadere sulla “macchina” robot che, almeno per il momento, non ha statuto giuridico?

Solo nell’ipotesi che il robot possegga una piena volontà autonoma e magari una coscienza riflessiva, capace di attribuire valore etico alle azioni che compie, si può pensare di attribuirgli una qualche responsabilità. Altrimenti essa continua a ripartirsi tra progettisti, costruttori, militari e politici. E’ evidente che si tratta di un problema etico che coinvolge sia i rapporti tra gli uomini sia il comportamento dei robot nei confronti degli uomini. Infatti la battaglia è un’impresa voluta da umani contro umani, ma è mediata e condotta da robot, che sono macchine (in prospettiva sempre più) autonome.

Osserviamo di passaggio che un robot soldato, benché votato ad azioni di morte, potrebbe conservare un residuo di eticità: anche se svincolato dalla Prima Legge, il robot dovrebbe poter riconoscere quando un nemico si arrende o non è più in condizioni di combattere, in modo da farlo prigioniero invece di ucciderlo.

Col tempo, e con le guerre innumerevoli, gli umani hanno sviluppato, nei confronti dei nemici o dei prigionieri, codici di comportamento che aprono isole di misericordia nell’oceano della crudeltà bellica. Si apre qui un problema analogo per i robot: come indurre in essi, nei confronti degli umani, comportamenti improntati alla pietas o in genere all'etica guerresca temperata? La domanda rivela il conflitto tra la natura macchinica dei robot, che dovrebbe renderli obbedienti alla nostra programmazione, e la loro (parziale) autonomia che, in linea di principio, potrebbe spingerli a decisioni arbitrarie, per esempio nocive nei confronti degli uomini al di là delle regole stabilite dalle convenzioni belliche, oppure, all'opposto, alla disobbedienza a qualunque ordine di uccisione in nome di una compassione generalizzata.

Il tentativo di far condurre le operazioni militari alle macchine non è certo nuovo, anche se in passato le macchine belliche erano semplici prolungamenti o potenziamenti del corpo umano. Lo scopo primario è quello di infliggere perdite al nemico risparmiando i propri combattenti, almeno finché il nemico non si dota degli stessi dispositivi. Per esempio, già nella seconda guerra mondiale i tedeschi usarono i Goliath, piccoli carri armati telecomandati; i missili Cruise non hanno pilota e si dirigono con buona precisione sul bersaglio.

Oggi gli Stati Uniti costruiscono robot con funzione di spionaggio e di combattimento, i cosiddetti SWORDS (letteralmente Spade, ovvero Special Weapon Observation Reconnaissance Detection Systems), dispositivi con mitragliatrice telecomandati fino a un chilometro di distanza. Gli SWORDS sono un primo passo, per quanto modesto, verso i Future Combat Systems (FCS), complessi di sorveglianza e attacco a distanza con missili e cannoni. I robot soldato si muovono su cingoli, ruote o gambe snodate e possono essere impiegati anche per il salvataggio di feriti e il recupero di materiale. Altri settori in cui si prospetta l’impiego dei robot soldato sono quelli della lotta al terrorismo e della repressione delle insurrezioni civili. La Francia sta costruendo un robot antisommossa e a Singapore si stanno sviluppando robot soldato per combattere la criminalità urbana riducendo le perdite tra le forze dell'ordine.

Come si vede, un giorno potrebbe essere un robot a ucciderci: come se non bastassero gli incidenti, le malattie e i nostri congeneri... Il robot soldato è un segno concreto della nostra natura violenta e malvagia che, nonostante i progressi fatti nel corso dei secoli, è rimasta sostanzialmente intatta e si rivela anche nella progettazione di questi manufatti micidiali. (9 - continua)

Se i robot diventano "macchine dolenti"

- 11443 reads

Dottor Gall: I Robot quasi non avvertono i dolori fisici. Ciò non ha dato buoni risultati. Dobbiamo introdurre la sofferenza.

Helena: E sono più felici se sentono il dolore?

Dottor Gall: Al contrario. Però sono tecnicamente più perfetti.

(Karel Čapek, R.U.R.)

L'evoluzione dei robot

Le leggi di Asimov hanno a che fare con il comportamento dei robot nei nostri confronti: ma c'è anche l'altra faccia della roboetica, quella che concerne il nostro comportamento verso i robot. Negli ultimi tempi si è acuita in molti Paesi la sensibilità nei confronti degli animali superiori, come le scimmie e gli animali domestici, ma non solo. Ne sono prova la nascita di associazioni animaliste e di movimenti antivivisezione, la diffusione dell’alimentazione vegetariana e il crescente rifiuto di pellicce, avorio e altri “prodotti” animali.

Questa maggior sensibilità è forse legata a un progressivo affrancamento degli animali dal ruolo di schiavi, di forza lavoro e di riserva di materiali utili cui sono stati a lungo relegati, ruolo che si è via via trasferito da una parte alle macchine e dall'altra ai prodotti di sintesi. A riprova si rifletta che le bestie allevate a scopo alimentare non beneficiano ancora di questo incremento di compassione, perché non abbiamo ancora trovato sostituti adeguati delle proteine animali. Dell’affrancamento hanno goduto e godono via via anche gli schiavi umani (spesso trattati come animali), non appena le loro funzioni si sono potute trasferire alle macchine.

E qui entrano in scena i robot, che stanno diventando gli esecutori di molti dei lavori finora svolti dagli animali, dagli schiavi e anche dalle macchine tradizionali. Può accadere che la sensibilità diffusa nei confronti degli umani e degli animali si trasferisca prima o poi anche ai robot, oppure ai nostri occhi prevarranno sempre la loro natura di artefatti e la loro funzione servile? Gli sforzi che facciamo per dotarli di intelligenza, autonomia, capacità di apprendere e tendenzialmente anche di sensibilità e di coscienza, avranno come corollario una loro equiparazione a qualcosa di più nobile e vicino a noi?

Ma c’è un’altra domanda, più inquietante: che diritto abbiamo di costruire macchine tanto intelligenti e sensibili da capire che non lo sono abbastanza? Perché suscitare dal nulla creature tanto simili a noi da essere capaci di soffrire? Il loro dolore, scaturito dalla consapevolezza di non essere del tutto assimilabili agli uomini, sarebbe un triste corollario della nostra abilità demiurgica: creando una schiatta di “macchine dolenti”, ci assumeremmo una pesante responsabilità.

Si osservi che il dolore dei robot deriverebbe, in questi scenari, dalla cognizione di non essere umani. E' un punto di vista sfacciatamente antropomorfo, che manifesta la presunzione del creatore: e in effetti visti i tanti difetti della nostra specie, forse i robot dovrebbero rallegrarsi di essere diversi da noi!

Insomma, lo struggente desiderio che i robot o gli androidi o i ciborg manifestano di diventare del tutto umani sulla base di un consapevole “senso di inferiorità”, desiderio che diviene ossessivo in Pinocchio e addirittura grottesco nel film di Spielberg, AI: Intelligenza Artificiale, è frutto al solito di una nostra proiezione. Che motivo avrebbero creature tanto diverse da noi (e forse tanto migliori di noi) per voler diventare proprio come noi, se non quello di compiacere i loro vanitosi creatori? Ancora una volta i desideri dei genitori vengono proiettati sui figli, con conseguenze forse disastrose.

A questo proposito, alcuni ritengono che un giorno potranno esistere robot più buoni degli esseri umani in virtù di un processo evolutivo che, innescato da noi, procederebbe poi in modo svincolato dai nostri condizionamenti. In fondo se noi siamo, in molte circostanze, aggressivi e malvagi ciò è dovuto al valore di sopravvivenza che queste caratteristiche hanno avuto nel corso dell’evoluzione in un ambiente ostile. Ma i robot si evolveranno in un ambiente molto diverso dal nostro: l’ambiente dei robot, in gran parte, siamo noi. Ecco perché (si pensi al caso dei robot soldato) se vogliamo che questa nuova stirpe sia migliore di noi e magari ci aiuti a migliorare noi stessi (perché l’ambiente dell’uomo potrebbero un giorno essere loro) dovremmo stare molto attenti all’“indole artificiale” che imprimiamo in queste creature, pur nei limiti delle derive imprevedibili dovute alla loro autonomia e alla loro interazione con l'ambiente. In questa prospettiva, instillare nei robot il desiderio di uguagliarci potrebbe segnare un regresso o almeno un ostacolo alla loro evoluzione etica verso la bontà.

Robot e ciborg

Gli stessi problemi si possono porre, e forse con fondamento ancora maggiore, per i ciborg, o cyborg, all'inglese, derivanti dall’ibridazione di esseri umani con componenti artificiali (si pensi al poliziotto ciborganico Alex Murphy del film Robocop di Paul Verhoeven, cui non si possono non attribuire ricordi, sentimenti e strazi affatto umani). Mentre il robot è completamente inorganico, il ciborg si costruisce partendo da una base umana e sostituendo o potenziando alcuni suoi organi ed apparati con dispositivi inorganici.

Il ciborg merita affetto e compassione oppure è uscito definitivamente dal consorzio umano per entrare in una sfera vaga e indefinibile e, in quanto privo di cittadinanza assodata, diventare preda di cacciatori senza scrupoli? I replicanti di Blade Runner di Ridely Scott, splendidi androidi e gineidi di dubbio statuto, debbono proprio essere eliminati? Insomma: chi decide che cosa significa essere umano e averne la dignità? Chi decide se anche certi non umani abbiano la stessa dignità degli umani? Forse un giorno non troppo lontano bisognerà scrivere una “Carta dei diritti” che consideri anche esseri la cui definizione sfugga ad ogni tentativo classificatorio basato sulle categorie tradizionali.

La confusione tra naturale e artificiale prodotta dalla robotica potrebbe prima o poi generare una confusione tra umano e non umano e aprirebbe lo spinoso problema della definizione di persona: quali sono i “requisiti minimi” che un ente deve possedere per essere dichiarato persona e quindi avere la dignità corrispondente? Esiste un grado di imitazione funzionale o di sostituzione protetica al quale è lecito, o inevitabile, parlare di umanità, e quindi di dignità, dell’artefatto? Un’altra domanda che scaturisce da queste considerazioni: gli artefatti imitativi potrebbero indurre cambiamenti nella nostra concezione del corpo e della natura umana (così come l’intelligenza artificiale ha modificato la nostra concezione di intelligenza)?

E, da ultimo, si noti che la costruzione dell’uomo artificiale potrebbe elevare gli artefatti alla dignità dell’uomo, oppure abbassare gli umani a livello delle macchine...

Emozioni artificiali

- 14650 reads

Io - E poi… hanno fatto degli uomini.

Minnie - Mamma mia!

Io - Ne hanno fatto dodici: sei uomini e sei donne.

Minnie - Per carità! Come erano?

Io - Precisi, come voi e come io.

Minnie - Dove sono?

Io - Non si sa. Li hanno cercati inutilmente. Sono in giro, chi sa dove. Erano perfetti. Impossibile distinguerli dagli uomini e dalle donne veri.

Minnie - Ho paura. Non uscirò più di casa. Perché non li trovano? Loro lo diranno, lo debbono dire, loro, che sono finti.

Io - Loro? Ma non lo sanno, naturalmente. Loro credono d'essere veri.

(Massimo Bontempelli, Giovane anima credula, 1925)

Ho accennato alle ricerche che si compiono per dotare i robot di emozioni artificiali e di coscienza, sempre artificiale, rendendoli così sempre più simili a noi. Le emozioni sono per gli umani un tratto costitutivo fondamentale, inseparabile dalle altre nostre caratteristiche: sono strettamente intrecciate alla razionalità computante, ma anche alle funzioni fisiologiche, alla memoria, all’esperienza, sono profondamente innestate nel corpo, inteso sia come insieme di organi sia come depositario della nostra identità, dei nostri ricordi e della nostra storia.

Le emozioni sono tanto pervasive che ogni nostro atto si colora di esse e ogni nostra relazione con noi stessi e con l’“altro” ne è condizionata. Ma che succede quando l’“altro” è inanimato, quando cioè non possiede di suo emozioni da scambiare con le nostre? In questo caso facciamo tutto noi: investiamo l’oggetto di un’intensa proiezione affettiva e giungiamo al punto di attribuirgli proprietà che non possiede. Dietro lo schermo di un computer immaginiamo un’intelligenza (quasi) umana, dietro la condotta e gli atteggiamenti di un robot immaginiamo sentimenti, giudizio e consapevolezza. Del resto, operiamo una proiezione di questo tipo anche nei confronti dei nostri simili, confortati in quest'operazione dalla comune origine e dalla rassomiglianza.

Un esempio di questa proiezione-attribuzione affettiva è offerto dal robot cane Aibo, di cui la Sony ha interrotto la produzione dopo averne costruito, dal 1999 al 2006, oltre 150.000 esemplari. Nel sito a lui dedicato, si legge che Aibo è un compagno gradevole e un intrattenitore nato, possiede l’istinto di girellare, cerca i suoi giocattoli e comunica col padrone, di cui riconosce la voce e il volto. Gli piace la musica e fa commenti sulle proprie sensazioni... Come per tanti altri robot, la “personalità” di Aibo si sviluppa tramite l’interazione con le persone e in base all’esperienza. Insomma è un compagno affettuoso e discreto, che non ha bisogno di cibo, non sporca, non chiede di fare la passeggiatina e che si può disattivare quando non “serve”: quanti vantaggi rispetto a un esigente e rumoroso cucciolo biologico! (Ma io non cambierei il mio formidabile bassotto Alcibiade con un Aibo per tutto l'oro del mondo…)

Da tempo ormai alla compagnia di un animale domestico si riconosce un notevole potere antidepressivo e ansiolitico, ma uno studio della Purdue University (Indiana, Stati Uniti) ha confermato che anche i robot zoomorfi possiedono, in parte, queste doti. Su 72 bambini tra i sette e i quindici anni intervistati nell’indagine (tutti possessori di un Aibo), 50 hanno dichiarato che i robot sono buoni compagni.

L’interazione con gli animali migliora il benessere psicologico dei bambini e la loro capacità di socializzare e di apprendere, ma ora il termine “animali” dev’essere forse esteso a comprendere anche Aibo e i suoi colleghi, come Paro, un cucciolo robotico di foca, il celebre pulcino Tamagochi, sempre bisognoso di cure e di affetto, e altri ancora. I ricercatori sostengono che lo studio dei rapporti tra i bambini e gli zoorobottini mira a comprendere meglio lo sviluppo infantile e nessuno ritiene che i robot sostituiranno mai gli animali, eppure in una società dove i rapporti umani sono sempre più sbrigativi e discontinui l'eventualità di delegare alle macchine una quota della nostra responsabilità comunicativa e affettiva non è poi tanto remota. Con quali conseguenze? E’ un tema da affrontare.

Un esempio reale di proiezione affettiva è fornito dal film Grizzly Man, di Werner Herzog, che narra la storia (vera) di Timothy Treadwell, un quarantenne disadattato che vive in Alasca a contatto con i temibili grizzly, trasgredendo, in uno slancio di empatia, il confine tra il sé e l’altro. Proiettando sugli orsi il proprio amore ai limiti del morboso, addirittura identificandosi con loro, Timothy s’illude di esserne ricambiato con lo stesso calore. Ma uno dei grizzly, che non gradisce questo travalicamento di confine e questa promiscuità eccessiva, lo sbrana e lo divora. Non voglio insinuare in alcun modo l’idea che il robot possa comportarsi in questo modo, ma non posso neppure escludere che dai robot attuali possano discendere, per evoluzione, creature aliene, così diverse da noi da non riconoscerci più non dico come loro creatori e padroni, ma neppure come entità altre da rispettare.

Tornando all’attualità dei rapporti uomo-robot, il problema non riguarda solo i bambini: si pensi al numero crescente di vecchi cui le famiglie non vogliono o non possono dedicare tempo e attenzione e che vengono accuditi da robot badanti. La possibilità di sostituire, almeno in parte, i rapporti umani con i rapporti robotici conferma la grande capacità di proiezione affettiva degli uomini, i quali tendono a interpretare azioni e reazioni puramente meccaniche (ma sono proprio tali? cioè: che cosa vuol dire “meccanico”?) come comportamenti intelligenti e coloriti di sentimenti: in fondo viviamo di apparenze.

La cosa è preoccupante, poiché dimostra la capacità della tecnica di insinuarsi subdolamente in noi per strade insospettabili, creando forme di dipendenza e vere e proprie “zone di anestesia” nella nostra diffidenza e nel nostro distacco verso gli artefatti. In questa invasione progressiva alcuni vedono una minaccia, tanto che in Giappone, Paese all’avanguardia nella robotica, si è deciso di non dotare i robot badanti di sembianze troppo umane, per evitare attaccamenti morbosi.

Provare le emozioni

Ma quando si parla di emozioni artificiali, s’intende qualcosa che vada oltre la simulazione dei sentimenti ottenuta per esempio mediante la mimica facciale e sostenuta dalla nostra proiezione. Se oggi si progettano agenti capaci di manifestare emozioni (con l’espressione, con l’atteggiamento e così via), un domani si vorrebbero costruire agenti capaci addirittura di provare (oltre che manifestare) emozioni. E’ un problema strettamente legato a quello della coscienza e porta a considerazioni dello stesso tipo. Si può dire che un agente artificiale manifesta emozioni quando si comporta in modi che, negli umani, presuppongono emozioni. Che poi si tratti di emozioni simulate, riconoscibili dal comportamento ma non avvertite, oppure di emozioni vere, di tipo psicologico e riflesse nella coscienza, resta un problema aperto e molto arduo.

Il robot amoroso

Un tema molto particolare, affrontato ma non ben risolto nel film AI: Intelligenza Artificiale, riguarda la costruzione di un robot che ci ami: è in un certo senso la situazione inversa rispetto a Grizzly Man, dov’è l’uomo che ama l’orso, cioè l’alieno. Creando un robot che lo ami, il costruttore raggiunge un vertice di egocentrismo: infatti non è previsto (o necessario) che l’uomo ricambi l’amore della creatura.

E’ facile e insieme rischioso tracciare un parallelo con il rapporto tra Dio e uomo. Come dice il catechismo, Dio ci ha creati per conoscerlo e amarlo. Se poi Dio ci ami è un problema molto più complicato, spesso risolto in modo sbrigativo affermando che l’amore di Dio è testimoniato dal fatto che ci ha messi al mondo, come se vivere fosse in sé un bene, cosa su cui non tutti concordano. Certo, tra gli esseri umani, l’assenza di simmetria nel rapporto d’amore può condurre a situazioni molto dolorose, addirittura tragiche, che alcuni uomini e donne conoscono per esperienza.

Il robot amoroso ci pone di fronte al conflitto tra la consapevolezza di aver di fronte una macchina (non degna d’amore) e il suo comportamento affettuoso che, unito al suo aspetto antropomorfo, spinge alla proiezione emotiva e al coinvolgimento. Del resto anche nel rapporto amoroso tra umani la proiezione svolge un ruolo fondamentale: non ci s’innamora di una persona, ma dell’immagine che si ha (che si costruisce) di quella persona.